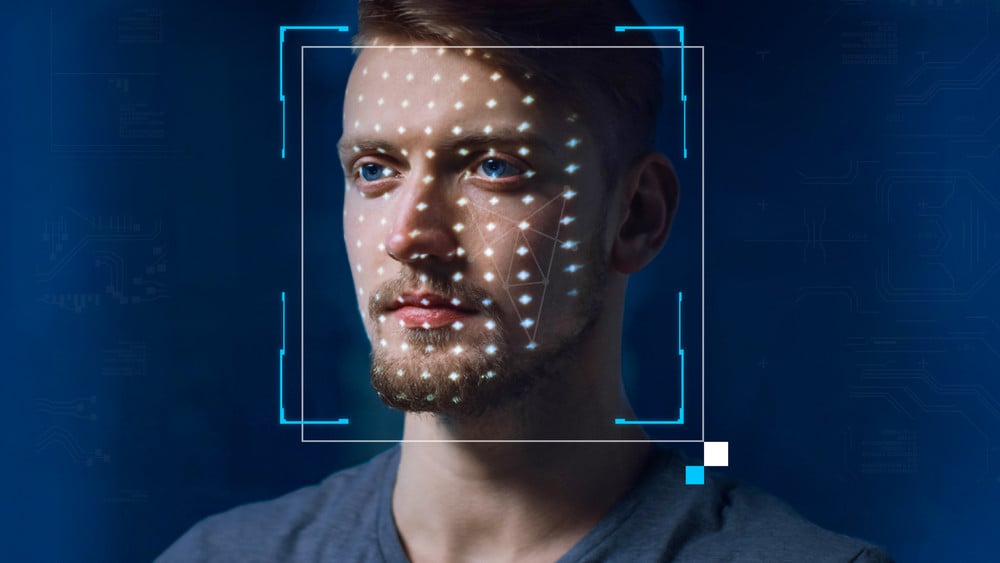

Mit Anschaffungskosten von nur etwa 1,3 Millionen VND rufen gefälschte Tools wie Gesichtstransplantationen und Stimmimitationen Warnungen hinsichtlich des Risikos von Betrug, gefälschten persönlichen Bildern und Folgen für die Cybersicherheit hervor.

(Illustration)

Günstige Preise im Darknet, große Gefahr verborgen

Das Global Research & Analysis Team (GReAT) von Kaspersky hat kürzlich Ergebnisse veröffentlicht, die zeigen, dass auf Darknet-Märkten zahlreiche Anzeigen aufgetaucht sind, die Dienste zur Erstellung von Deepfake -Videos und -Audios in Echtzeit anbieten. Die Einstiegspreise für gefälschte Sprachnachrichten liegen je nach Komplexität und Länge des Inhalts bei etwa 50 US-Dollar (ca. 1,3 Millionen VND) bzw. 30 US-Dollar (ca. 800.000 VND).

Bisher kosteten „legitime“ Deepfake-Dienste zwischen 300 und 20.000 US-Dollar pro Minute.

Der starke Preisverfall – 400-mal niedriger als das vorherige populäre Niveau – erhöht das Risiko, für schlechte Taten ausgenutzt zu werden, noch weiter.

Werbefunktionen und „Köder“ von Bösewichten

Die Anzeigen gehen mittlerweile über einfache Fake-Videos hinaus und beinhalten den Echtzeit-Gesichtsaustausch während Videoanrufen, das Fälschen von Gerätekameras oder das „Ersetzen“ von Gesichtern, um die Authentifizierung zu umgehen. Sie werben auch mit der Möglichkeit, Gesichtsausdrücke mit Voiceovers zu synchronisieren und unterstützen sogar mehrere Sprachen.

Darüber hinaus werden auch „Voice-Cloning“-Dienste angeboten, die Stimmimitationen ermöglichen und dabei Tonhöhe und Klangfarbe anpassen, um unterschiedliche Emotionen auszudrücken. Viele Experten vermuten jedoch, dass es sich dabei um kundenködernde Werbung handelt – Käufer werden möglicherweise dazu verleitet, im Voraus Geld zu überweisen, erhalten aber nicht das versprochene Qualitätsprodukt.

„Auch der Bedarf, dieses Tool zu nutzen, steigt“

„Wir haben nicht nur Werbung gesehen, die Deepfake als Service anbietet, sondern auch eine steigende Nachfrage nach diesen Tools festgestellt“, sagte Dmitry Galov , Leiter des GReAT-Teams von Kaspersky (Russland und GUS) .

Cyberkriminelle experimentieren mit KI und integrieren sie in ihre Angriffsstrategien, sagte er. Einige Plattformen entwickeln sogar ihre eigenen „bösartigen“ LLMs, die von öffentlichen Modellen getrennt sind und direkt auf den Geräten der Bösewichte ausgeführt werden können.

Obwohl Deepfakes noch nicht als völlig neue Cyberbedrohung gelten können, könnte die Technologie die Angriffe raffinierter und schwerer erkennbar machen.

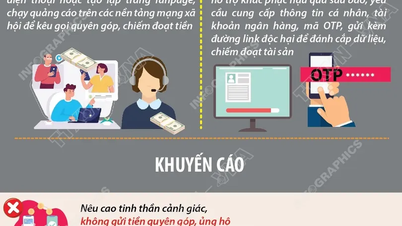

Empfehlungen und wie man Deepfake erkennt

Kaspersky empfiehlt Unternehmen und Organisationen, umfassende Maßnahmen zur Cybersicherheit zu ergreifen. Dabei sollten sie sich nicht mit der Installation von Schutzsoftware begnügen, sondern auch ein Team aus IT-Experten aufbauen, die über die nötigen Fähigkeiten zur Erkennung und Reaktion verfügen.

Darüber hinaus sollten die Mitarbeiter der Organisation darin geschult werden, ungewöhnliche Anzeichen in Video- oder Audioaufnahmen zu erkennen, die auf Deepfake-Technologie zurückzuführen sein könnten. Diese Videos weisen häufig ruckartige und unnatürliche Bewegungen, ungleichmäßige Beleuchtung oder Hauttöne zwischen den Bildern auf, Figuren, die mit ungewöhnlicher oder fast keiner Blinzelfrequenz erscheinen, und Gesichter, die verzerrt oder leicht deformiert sein können.

Darüber hinaus ist die Bildqualität oft schlecht und die Einzelbilder sind instabil, insbesondere bei schwachem Licht, wodurch das gesamte Video weniger realistisch wirkt. Wachsamkeit gegenüber Deepfake-Bedrohungen und die Sensibilisierung für diese Bedrohungen gelten als wichtiger erster Schritt, um den Schaden durch ausgeklügelte Betrügereien im KI-Zeitalter zu minimieren.

Quelle: https://doanhnghiepvn.vn/chuyen-doi-so/rui-ro-tu-deepfake-gia-re-tu-quang-cao-darknet-den-loi-keu-goi-canh-giac/20251016105304840

![[Foto] Generalsekretär To Lam nimmt am 18. Parteitag in Hanoi (Legislaturperiode 2025–2030) teil](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/16/1760581023342_cover-0367-jpg.webp)

![[Foto] Die Zeitung Nhan Dan bringt „Vaterland im Herzen: Der Konzertfilm“ heraus.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/16/1760622132545_thiet-ke-chua-co-ten-36-png.webp)

![[Video] TripAdvisor würdigt viele berühmte Sehenswürdigkeiten von Ninh Binh](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/16/1760574721908_vinh-danh-ninh-binh-7368-jpg.webp)

![[Foto] Die Zeitung Nhan Dan bringt „Vaterland im Herzen: Der Konzertfilm“ heraus.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/16/1760622132545_thiet-ke-chua-co-ten-36-png.webp)

Kommentar (0)