|

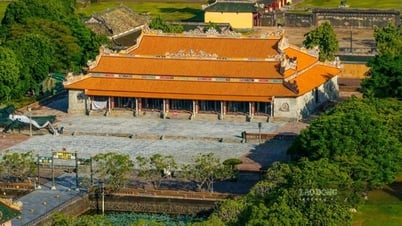

Anthropic hat gerade seine neue Richtlinie aktualisiert. Foto: GK Images . |

Am 28. August kündigte das KI-Unternehmen Anthropic eine Aktualisierung seiner Nutzungsbedingungen und Datenschutzrichtlinie an. Nutzer können nun der Verwendung ihrer Daten zur Verbesserung von Claude und zum Schutz vor Missbrauch wie Betrug und Betrug zustimmen.

Dieser Hinweis wird ab dem 28. August im Chatbot veröffentlicht. Nutzer haben einen Monat Zeit, die Bedingungen zu akzeptieren oder abzulehnen. Die neuen Richtlinien treten sofort nach Annahme in Kraft. Nach dem 28. September müssen Nutzer erneut zustimmen, um Claude weiterhin nutzen zu können.

Die Updates sollen laut Unternehmen dazu beitragen, leistungsfähigere und nützlichere KI-Modelle bereitzustellen. Die Anpassung dieser Option ist einfach und kann jederzeit in den Datenschutzeinstellungen vorgenommen werden.

Diese Änderungen werden an den Tarifen Claude Free, Pro und Max vorgenommen, die Claude Code, das Programmiertool von Anthropic, enthalten. Dienste, die unter die Geschäftsbedingungen fallen, gelten nicht, darunter Claude for Work, Claude Gov, Claude for Education oder die Nutzung von APIs, auch über Drittanbieter wie Amazon Bedrock und Vertex AI von Google Cloud.

Durch die Teilnahme, so Anthropic in seinem Blogbeitrag, tragen Nutzer dazu bei, die Sicherheit des Modells zu verbessern, schädliche Inhalte präziser zu erkennen und das Risiko zu verringern, harmlose Gespräche fälschlicherweise zu kennzeichnen. Zukünftige Versionen von Claude werden zudem um Fähigkeiten wie Programmieren, Analysieren und logisches Denken erweitert.

Wichtig ist, dass Nutzer die volle Kontrolle über ihre Daten haben und in einem Pop-up-Fenster festlegen können, ob sie der Plattform die Nutzung erlauben. Neue Accounts können dies optional während des Registrierungsprozesses einrichten.

|

Neues Popup-Fenster mit Begriffen im Chatbot. Foto: Anthropic. |

Die Datenaufbewahrungsfrist wurde auf fünf Jahre erhöht. Dies gilt für neue oder fortgesetzte Konversationen oder Programmiersitzungen sowie für Antworten auf Chatbot-Antworten. Gelöschte Daten werden zukünftig nicht mehr zum Trainieren des Modells verwendet. Wenn Nutzer der Bereitstellung von Daten für das Training nicht zustimmen, gilt weiterhin die aktuelle 30-tägige Aufbewahrungsfrist.

Anthropic erläuterte die Richtlinie, dass sich KI-Entwicklungszyklen typischerweise über Jahre erstrecken. Die Konsistenz der Daten während des gesamten Trainingsprozesses trage auch dazu bei, die Konsistenz der Modelle zu gewährleisten. Eine längere Datenspeicherung verbessere zudem Klassifikatoren, Systeme zur Erkennung missbräuchlichen Verhaltens, um schädliche Muster zu erkennen.

„Um die Privatsphäre der Nutzer zu schützen, verwenden wir eine Kombination aus automatisierten Tools und Prozessen, um sensible Daten zu filtern oder zu maskieren. Wir verkaufen keine Nutzerdaten an Dritte“, schrieb das Unternehmen.

Anthropic wird oft als einer der führenden Anbieter sicherer KI genannt. Anthropic hat eine Methodik namens „Constitutional AI“ entwickelt, die ethische Prinzipien und Richtlinien festlegt, denen Modelle folgen müssen. Anthropic ist außerdem eines der Unternehmen, die die Safe AI Commitments mit den Regierungen der USA, Großbritanniens und der G7-Staaten unterzeichnet haben.

Quelle: https://znews.vn/cong-ty-ai-ra-han-cuoi-cho-nguoi-dung-post1580997.html

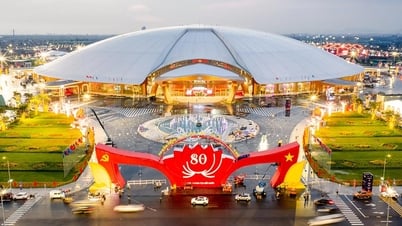

![[Foto] Hanoi ist bereit, die Feierlichkeiten zum 80. Nationalfeiertag am 2. September zu begehen](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/29/c838ac82931a4ab9ba58119b5e2c5ffe)

Kommentar (0)