|

|

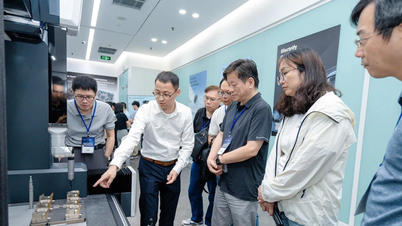

Sử dụng kỹ thuật cải tiến từ cách huấn luyện AI của DeepSeek, chip Huawei Ascend đã cho hiệu suất vượt trội. Ảnh: Reuters. |

Theo SCMP, các nhà nghiên cứu làm việc trên mô hình ngôn ngữ lớn (LLM) Pangu của Huawei ngày 4/6 tuyên bố đã cải thiện cách tiếp cận ban đầu của DeepSeek để huấn luyện trí tuệ nhân tạo (AI) bằng cách tận dụng phần cứng độc quyền của công ty này.

Cụ thể, bài báo được xuất bản bởi nhóm Pangu của Huawei, bao gồm 22 cộng tác viên cốt lõi và 56 nhà nghiên cứu bổ sung, đã giới thiệu khái niệm Mixture of Grouped Experts (MoGE). Đây là phiên bản nâng cấp của kỹ thuật Mixture of Experts (MoE) đóng vai trò quan trọng trong các mô hình AI được chứng minh là có hiệu quả về chi phí của DeepSeek.

Theo bài báo, mặc dù MoE cung cấp chi phí thực thi thấp cho các tham số mô hình lớn và khả năng học tập nâng cao, nhưng nó cũng thường dẫn đến sự thiếu hiệu quả. Điều này xuất phát từ việc kích hoạt không đồng đều, dẫn đến cản trở hiệu suất khi chạy trên nhiều thiết bị song song.

Trong khi đó, theo các nhà nghiên cứu cho biết, MoGE được cải tiến bởi nhóm các chuyên gia trong quá trình lựa chọn và cân bằng tốt hơn khối lượng công việc của "chuyên gia".

Trong huấn luyện AI, thuật ngữ "chuyên gia" đề cập đến các mô hình con hoặc thành phần chuyên biệt trong một mô hình lớn hơn. Mỗi mô hình này sẽ được thiết kế để xử lý các tác vụ cụ thể hoặc loại dữ liệu riêng biệt. Điều này cho phép hệ thống tổng thể tận dụng chuyên môn đa dạng để nâng cao hiệu suất.

Theo Huawei, quá trình huấn luyện bao gồm 3 giai đoạn chính: tiền huấn luyện, mở rộng ngữ cảnh dài và hậu huấn luyện. Toàn bộ quá trình đã bao gồm giai đoạn tiền huấn luyện trên 13.200 tỷ token và mở rộng ngữ cảnh dài bằng cách sử dụng 8.192 chip Ascend - bộ xử lý AI mạnh nhất của Huawei, dùng trong đào tạo các mô hình AI và có mục tiêu thách thức sự thống trị của Nvidia trong thiết kế chip cao cấp.

Nhờ thử nghiệm kiến trúc mới trên bộ xử lý thần kinh (NPU) Ascend được thiết kế đặc biệt để tăng tốc các tác vụ AI, các nhà nghiên cứu đã nhận thấy MoGE "dẫn đến sự cân bằng tải chuyên gia tốt hơn và thực hiện hiệu quả hơn cho cả huấn luyện và suy luận mô hình".

Kết quả, so với các mô hình như DeepSeek-V3, Qwen2.5-72B của Alibaba và Llama-405B của Meta Platforms, Pangu đạt hiệu suất vượt trội trên hầu hết bài kiểm tra điểm chuẩn tiếng Anh tổng quát và tất cả bài kiểm tra điểm chuẩn tiếng Trung, cho thấy hiệu quả cao hơn trong huấn luyện ngữ cảnh dài.

Nguồn: https://znews.vn/huawei-tuyen-bo-huan-luyen-ai-tot-hon-deepseek-post1558359.html

![[Ảnh] Tổng Bí thư Tô Lâm tiếp Đại sứ Hàn Quốc tại Việt Nam](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/6/a0765b7543784cbcbfe4755b67d43ab4)

![[Ảnh] Chủ tịch nước Lương Cường làm việc với Tỉnh ủy Hưng Yên và Thái Bình về thực hiện Nghị quyết Hội nghị Trung ương 11, khóa XIII](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/6/127b735d2761484d81dcee0d7725a25b)

![[REVIEW OCOP] Siro Tú Duyên - Tinh tuý từ thảo mộc núi rừng Như Thanh](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/6/5/58ca32fce4ec44039e444fbfae7e75ec)

Bình luận (0)