|

Anthropicが新しいポリシーを更新しました。写真: GK Images 。 |

AI企業Anthropicは8月28日、利用規約とプライバシーポリシーの更新を発表しました。ユーザーは、Claudeの改善と詐欺などの不正行為に対する保護強化のために、自身のデータを利用することに同意できるようになりました。

このお知らせは8月28日よりチャットボットに公開されます。ユーザーは1ヶ月以内に利用規約に同意するか拒否するかを選択できます。新しいポリシーは同意後直ちに有効になります。9月28日以降は、Claudeのご利用を継続するにはオプトインが必要となります。

同社によると、今回のアップデートは、より強力で有用なAIモデルの提供を支援することを目的としています。このオプションの調整は簡単で、プライバシー設定からいつでも行うことができます。

これらの変更は、Claude Free、Pro、Maxプランに適用されます。これらのプランには、AnthropicのプログラミングツールであるClaude Codeが含まれています。商用利用規約の対象となるサービス(Claude for Work、Claude Gov、Claude for Educationなど)や、Amazon BedrockやGoogle CloudのVertex AIなどのサードパーティ経由のAPIの使用は適用されません。

アントロピックはブログ投稿で、ユーザーが参加することでモデルの安全性向上に貢献し、有害コンテンツを正確に検出する能力が向上し、無害な会話を誤ってフラグ付けするリスクが軽減されると述べています。Claudeの将来のバージョンでは、プログラミング、分析、推論などのスキルも強化される予定です。

ユーザーが自分のデータを完全に管理し、プラットフォームがポップアップウィンドウでデータを使用することを許可するかどうかを決定することが重要です。新規アカウントでは、登録プロセス中にオプションでこれを設定することができます。

|

チャットボットの新しい利用規約ポップアップウィンドウ。写真: Anthropic。 |

データ保持期間が5年に延長されました。これは、新規または継続中の会話やコーディングセッション、そしてチャットボットへの応答に適用されます。削除されたデータは、今後モデルの学習には使用されません。ユーザーが学習用データの提供に同意しない場合は、現在の30日間の保持ポリシーが継続されます。

アントロピック社は、この方針を説明するにあたり、AIの開発サイクルは通常数年に及ぶため、学習プロセス全体を通してデータの一貫性を保つことは、モデルの一貫性維持にも役立つと述べました。また、データの保持期間を長くすることで、悪質な行動を識別するために使用される分類器の性能が向上し、有害なパターンを検出しやすくなります。

「ユーザーのプライバシーを保護するため、当社は自動化されたツールとプロセスを組み合わせて、機密データをフィルタリングまたはマスキングしています。ユーザーデータを第三者に販売することはありません」と同社は述べている。

Anthropicは、安全なAIのリーダーとしてしばしば挙げられます。Anthropicは、モデルが遵守すべき倫理原則とガイドラインを定めた「Constitutional AI」と呼ばれる方法論を開発しました。また、Anthropicは、米国、英国、G7諸国政府と共同で「Safe AI Commitments(安全なAIコミットメント)」に署名した企業の一つでもあります。

出典: https://znews.vn/cong-ty-ai-ra-han-cuoi-cho-nguoi-dung-post1580997.html

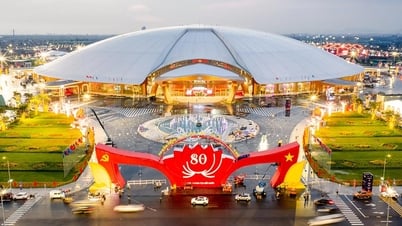

![[写真] ハノイは9月2日の建国80周年記念式典に備えている](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/29/c838ac82931a4ab9ba58119b5e2c5ffe)

コメント (0)