Laut The Hacker News hat Wiz Research – ein Cloud-Sicherheits-Startup – kürzlich ein Datenleck im GitHub-Repository von Microsoft AI entdeckt, das angeblich versehentlich bei der Veröffentlichung einer Gruppe von Open-Source-Trainingsdaten offengelegt wurde.

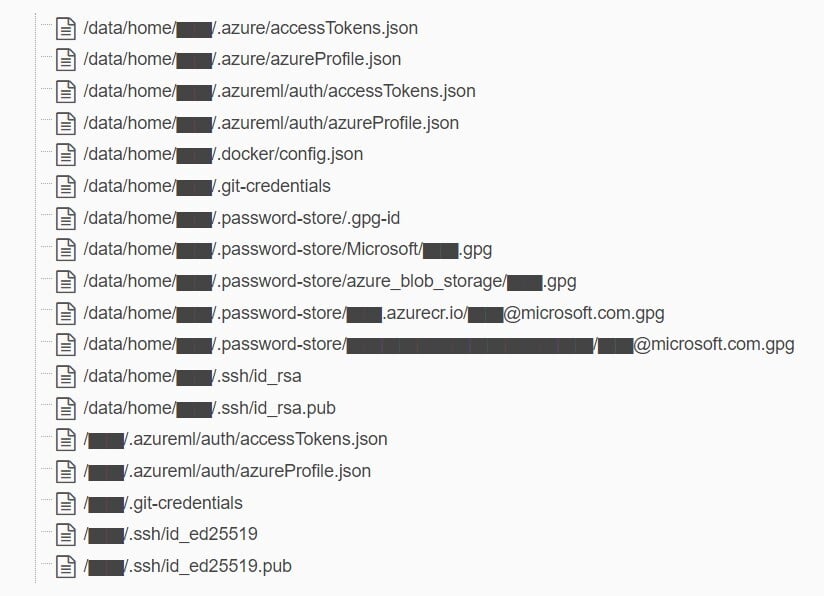

Zu den durchgesickerten Daten gehört ein Backup der Workstations zweier ehemaliger Microsoft-Mitarbeiter mit geheimen Schlüsseln, Passwörtern und mehr als 30.000 internen Teams-Nachrichten.

Das Repository mit dem Namen „robust-models-transfer“ ist derzeit nicht mehr zugänglich. Vor seiner Entfernung enthielt es Quellcode und Machine-Learning-Modelle im Zusammenhang mit einer Forschungsarbeit aus dem Jahr 2020.

Wiz erklärte, der Datenverstoß sei auf eine Sicherheitslücke bei SAS-Token zurückzuführen. SAS-Token sind eine Funktion in Azure, die es Benutzern ermöglicht, Daten zu teilen, die schwer zu verfolgen und zu widerrufen sind. Der Vorfall wurde Microsoft am 22. Juni 2023 gemeldet.

Dementsprechend wurden Entwickler in der README.md-Datei des Repositorys angewiesen, Modelle von einer Azure Storage-URL herunterzuladen, wodurch unbeabsichtigt Zugriff auf das gesamte Speicherkonto gewährt und somit weitere private Daten offengelegt wurden.

Die Wiz-Forscher erklärten, dass neben dem übermäßigen Zugriff auch das SAS-Token falsch konfiguriert war und volle Kontrolle statt nur Lesezugriff ermöglichte. Ein Angriff könnte alle Dateien im Speicherkonto nicht nur anzeigen, sondern auch löschen und überschreiben.

Microsoft erklärte in seiner Untersuchung, es seien keine Hinweise auf die Offenlegung von Kundendaten gefunden worden. Auch seien durch den Vorfall keine anderen internen Dienste gefährdet gewesen. Das Unternehmen betonte, dass Kunden nichts unternehmen müssten. SAS-Token seien widerrufen und sämtliche externen Zugriffe auf Speicherkonten gesperrt worden.

Um ähnliche Risiken zu minimieren, hat Microsoft seinen geheimen Scan-Dienst erweitert, um nach SAS-Token mit möglicherweise eingeschränkten oder übermäßigen Berechtigungen zu suchen. Außerdem wurde ein Fehler im Scan-System festgestellt, der SAS-URLs im Repository fälschlicherweise markierte.

Forscher weisen darauf hin, dass aufgrund mangelnder Sicherheit und Governance für SAS-Kontotoken die Verwendung für externe Freigaben vermieden werden sollte. Fehler bei der Tokengenerierung können leicht übersehen werden und sensible Daten offenlegen.

Bereits im Juli 2022 hatte JUMPSEC Labs eine Bedrohung angekündigt, die diese Konten ausnutzen könnte, um Zugriff auf Unternehmen zu erhalten.

Wiz Research hat vertrauliche Dateien in Backups gefunden

Dies ist die jüngste Sicherheitslücke bei Microsoft. Vor zwei Wochen gab das Unternehmen bekannt, dass Hacker aus China in das System eingedrungen waren und Hochsicherheitsschlüssel gestohlen hatten. Hacker übernahmen das Konto eines Ingenieurs des Unternehmens und griffen auf das digitale Signaturarchiv des Benutzers zu.

Der jüngste Vorfall zeige die potenziellen Risiken der Integration von KI in große Systeme, sagt Ami Luttwak, CTO von Wiz. Da Datenwissenschaftler und Ingenieure jedoch um die Implementierung neuer KI-Lösungen wetteifern, erfordern die enormen Datenmengen, die sie verarbeiten, zusätzliche Sicherheitskontrollen und -vorkehrungen.

Da viele Entwicklungsteams mit riesigen Datenmengen arbeiten, diese Daten mit ihren Kollegen teilen oder an öffentlichen Open-Source-Projekten zusammenarbeiten müssen, werden Fälle wie der von Microsoft immer schwieriger zu verfolgen und zu vermeiden.

[Anzeige_2]

Quellenlink

Kommentar (0)