AI のパフォーマンスとエネルギー消費の関係を規制するには、さらなる標準が必要です。

2025 年 6 月 23 日、著者の Kameryn Griesser 氏は記事「AI プロンプトが環境に悪影響を及ぼす可能性があります」の中で、生成型人工知能 (AI) の急速な発展と潜在的な環境コストについて、あまり知られていないがますます懸念される側面を明らかにしました。

AIは利便性を生み出すが、環境に影響を与える

生成AIモデルは、個人や組織において日常的な問題解決のためのツールとしてますます利用されています。しかし、その利便性の裏には厳しい現実が隠されています。AIが解決するあらゆる問題には、隠れた環境コストが伴い、そのコストはますます増大しており、その核心はAIの仕組みにあります。

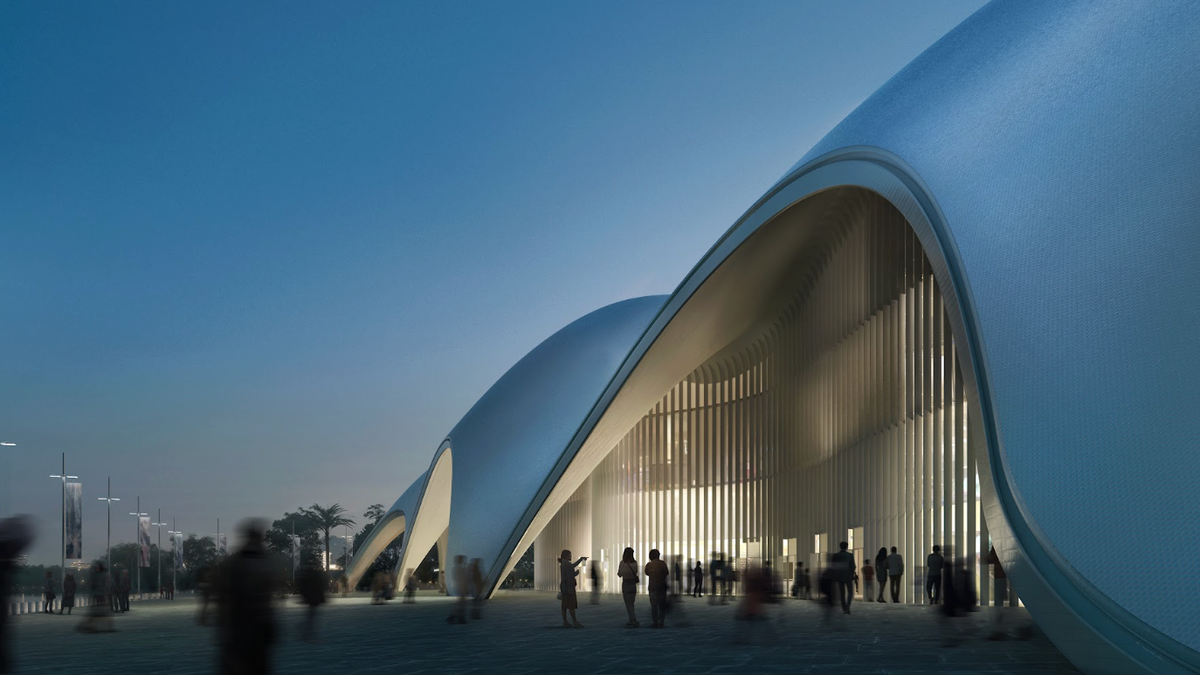

ユーザーが入力するプロンプト内の各単語は、「トークンID」と呼ばれる数字の集合に分解されます。そして、これらは巨大なデータセンターに送信されます。その規模は、フットボール場よりも大きいものもあります。

ここでは、大型コンピューターが数十回の高速計算を実行して応答を生成します。

これらのセンターは、深刻な環境汚染を引き起こす化石燃料である石炭火力発電所や天然ガス火力発電所によって電力を供給されていることが多い。

電力研究所によるよく引用される推定によると、コンピューティングプロセス全体は、一般的な Google 検索の 10 倍のエネルギーを消費する可能性があり、特に今日の AI の使用頻度と規模を考えると、これは憂慮すべきことです。

被害の程度を測る基準が必要

それぞれの AI プロンプトによる「損害」を定量化するために、ドイツの研究者が広範な調査を実施しました。

彼らは14の大規模言語モデル(LLM)システムを、自由回答式と多肢選択式の質問の両方を用いてテストしました。Frontiers in Communication誌に掲載されたこの研究の結果は、いくつかの重要な発見を示しました。

Tuoi Tre Onlineによると、複雑な質問は、簡潔な回答の質問に比べて6倍の二酸化炭素排出量を生み出します。これは、明確で要点を押さえた質問でAIを慎重に活用することで、環境への影響を軽減できる可能性を示唆しています。

通常、これらのより「スマート」で、よりエネルギー集約的な LLM には、より小さく簡潔なモデルよりも多くの、ID トークンの処理に使用される重みである数百億のパラメーターがあります。

ダウナー氏はこれを脳内の神経ネットワークに例え、「神経のつながりが多ければ多いほど、質問に答えるためにより多くの思考をすることができます」と述べている。

推論能力とパフォーマンスは望ましいレベルを超えていますが、大量のエネルギーを消費するため、持続可能な AI 開発の課題となっています。

行動の呼びかけと将来の解決策

Tuoi Tre Onlineによると、 AIを日常業務に統合することの普及は、深刻化する気候危機の状況において厄介な問題を提起している。

これは、テクノロジーを利用する際に私たちが環境に対して負う責任を改めて認識させるものでもあります。ユーザーは、AIの利用に伴う潜在的な環境コストについて理解する必要があります。

AI業界は、よりエネルギー効率の高いモデルとアーキテクチャの研究開発を優先する必要があります。これには、アルゴリズムの最適化、より環境に優しいデータセンターの利用、エネルギー消費量の少ないコンピューティング手法の検討などが含まれます。

さらに、AI開発者やサービスプロバイダーは、自社製品の使用に伴うカーボンフットプリントについて、より透明性を高める必要があります。これにより、ユーザーや企業はより情報に基づいた選択を行えるようになります。

さらに、AIの性能とエネルギー消費の関係をより深く理解し、環境への影響を軽減する解決策を見つけるためには、さらなる研究が必要です。 科学者、技術者、政策立案者間の連携が不可欠です。

AI技術との関わり方を改めて考え直し、将来の持続可能性について重要な問いを投げかける時が来ています。AIが進化し、より強力になるにつれ、エネルギーと二酸化炭素排出量の負担への対処はもはや選択肢ではなく、技術の進歩が環境悪化を犠牲にしないよう徹底するための緊急の課題となります。

出典: https://tuoitre.vn/moi-cau-lenh-cho-ai-deu-gay-o-nhiem-moi-truong-20250625114142376.htm

コメント (0)