|

試合の解説には有名人の声が使われている。写真: Meta 。 |

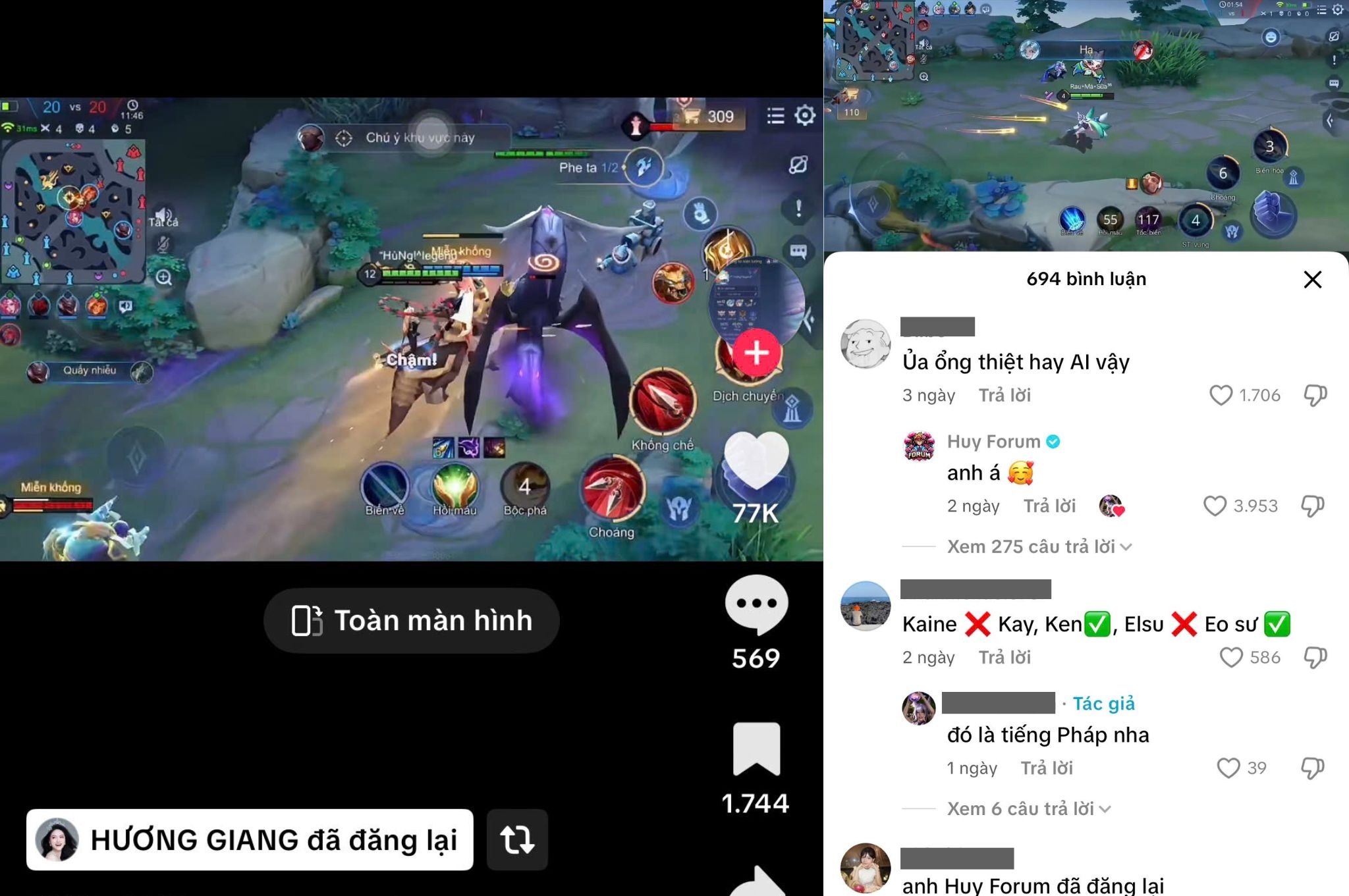

最近、TikTokを中心としたソーシャルネットワーク上で、ゲームをプレイしながら画面を録画した動画が次々と登場しています。特に注目すべきは、実況音声が著名人によるもの。Huong Giang、Bich Phuong、Phuong My Chiといったアーティストや、Huy Forum、Tho Nguyen、Jenny HuynhといったTikTokユーザーが、Lien Quan Mobileなどのゲームを分析し、 実況しています。

しかし、実際にアーティストが動画に声を吹き込んだわけではなく、ユーザーがAIを使って声を真似していました。あるアカウントの指示に従い、そのユーザーはMinimaxというツールを使ってテキストを音声に変換しました。

Minimax Technologyは、短い録音から音声を複製する機能で知られる中国のAI企業です。Minimaxは、OpenAI TTSやElevenLabsといった他のプラットフォームと連携し、技術的な障壁を下げ、誰でも誰の声でも作成できるようにしました。

Minimaxは、テンセント、アリババなどの大企業や多くのベンチャーキャピタルファンドの支援を受けています。同社の顧客は、ゲーム、 教育、金融、エンターテインメントなど、多岐にわたる業界に及び、共通の用途として、ビデオゲームの吹き替え、スポーツハイライトの解説、コメディ動画への追加などが挙げられます。

有名人の声を使ったショートクリップは、瞬く間に拡散し、簡単にトレンドになる可能性を秘めています。視聴者は、お気に入りの有名人が試合の解説をしたり、話題のフレーズを言ったりするのを聞くことで、新鮮さや面白さを感じるでしょう。

ほとんどの人がこれをAIの声だと認識し、意図的に有名人の声を称賛するコメントを投稿しました。Huong Giang氏やHuy Forum氏のような実在の人物も、自分の声がユーモラスに使われたことに喜びを表明し、そのコンテンツをリポストしました。

|

フオン・ザン氏とフイ・フォーラム氏は、AI動画を自身の声を使ってリポストした。写真: TikTok |

利用可能な動画はわずか数本しかないため、ユーザーは真似したい内容を入力し、数分待つだけで完成版が完成します。その結果、多くの新規アカウントが作成され、例えば有名人の名前にゲームタイトルを添えた構文を使って、このような動画を投稿しています。「連泉をプレイしない有名人はほとんどいない」と、あるコメント投稿者は冗談めかして語りました。

オンライン空間にエンターテイメントをもたらす一方で、一部のユーザーはこの機能を悪用し、悪質な目的に利用しています。Deepvoice詐欺はますます巧妙化しており、緊急事態において愛する人の声を悪用して即時送金を強要するケースも増えています。

ベトナムでは、最近、親に電話をかけ、子供が事故に遭ったので手術のためにすぐにお金を送金する必要があると告げるタイプの詐欺が流行している。

海外では、英国のある会社の取締役が、「上司」から電話で送金を依頼され、 24万ドル以上を騙し取られた。香港のある金融従業員は、「取締役」からの電話を受け、 330万ドルを振り込まされるという詐欺被害に遭った。

中国では、Minimaxなどの音声AI企業は「許可なく人間の声を盗用しない」という規定をしばしば設けていますが、実際には制御が非常に困難です。この技術は、有名人の顔を使ったディープフェイクと非常に似ていますが、違法広告、物議を醸す発言、フェイクニュースなどに利用されるのは声であるという点が異なります。

ドレイクやザ・ウィークエンドといった多くの国際的なアーティストは、自分たちの声を使った「AIカバー」が話題になった際に声を上げました。AIによるプライバシー侵害やフェイクニュースの拡散といった問題も、世界中の多くの国で議論を巻き起こしており、適切な法的枠組みの確立を目指しています。

音声クローンは、上記のような娯楽動画の吹き替えに加え、亡くなった愛する人の声を再現したり、声を失った人々のサポートなど、前向きな目的にも活用できます。しかし、高い悪用リスクを効果的に抑制・軽減するためには、声を使用するすべての人にその事実を知らせる必要があります。

出典: https://znews.vn/su-that-ve-clip-phuong-my-chi-huong-giang-binh-luan-game-post1579300.html

コメント (0)