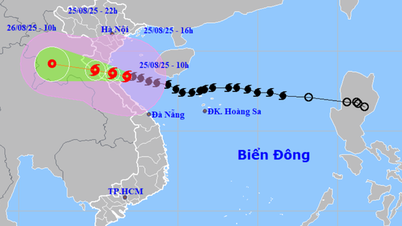

Laut BGR wurde in einem neuen Forschungsbericht gerade eine alarmierende Technik namens „Fun-Tuning“ veröffentlicht, bei der KI (künstliche Intelligenz) selbst verwendet wird, um automatisch äußerst effektive Prompt-Injection-Angriffe zu erstellen, die auf andere fortschrittliche KI-Modelle abzielen, darunter auch Googles Gemini.

Die Methode macht das „Knacken“ von KI schneller, billiger und einfacher als je zuvor und markiert eine neue Eskalation im Kampf um die Cybersicherheit im Zusammenhang mit KI.

Die Gefahr, wenn Bösewichte KI nutzen, um KI zu knacken

Prompt Injection ist eine Technik, bei der ein Angreifer bösartige Anweisungen in die Eingabedaten eines KI-Modells einschleust (z. B. über Kommentare im Quellcode oder versteckten Text im Web). Ziel ist es, die KI dazu zu bringen, vorprogrammierte Sicherheitsregeln zu umgehen. Dies kann schwerwiegende Folgen haben, wie z. B. die Weitergabe sensibler Daten, die Bereitstellung falscher Informationen oder andere bösartige Aktionen.

Hacker nutzen KI, um KI anzugreifen

FOTO: LINKEDIN-SCREENSHOT

Bisher waren für die erfolgreiche Ausführung dieser Angriffe, insbesondere bei „geschlossenen“ Modellen wie Gemini oder GPT-4, häufig umfangreiche, komplexe und zeitaufwändige manuelle Tests erforderlich.

Doch Fun-Tuning hat die Spielregeln völlig verändert. Die Methode wurde von einem Forscherteam mehrerer Universitäten entwickelt und nutzt auf clevere Weise die Tuning-API (Application Programming Interface), die Google Gemini-Nutzern kostenlos zur Verfügung stellt.

Durch die Analyse der subtilen Reaktionen des Gemini-Modells während des Tunings (z. B. wie es auf Fehler in den Daten reagiert) kann Fun-Tuning automatisch die effektivsten „Präfixe“ und „Suffixe“ ermitteln, um einen bösartigen Befehl zu verbergen. Dies erhöht die Wahrscheinlichkeit erheblich, dass die KI den bösartigen Absichten des Angreifers nachkommt.

Testergebnisse zeigen, dass Fun-Tuning bei einigen Versionen von Gemini eine Erfolgsquote von bis zu 82 % erreicht, ein Wert, der die weniger als 30 % herkömmlicher Angriffsmethoden übertrifft.

Die geringen Kosten von Fun-Tuning erhöhen die Gefahr zusätzlich. Da Googles Tuning-API kostenlos verfügbar ist, betragen die Rechenkosten für einen effektiven Angriff nur 10 US-Dollar. Darüber hinaus stellten die Forscher fest, dass ein für eine Version von Gemini entwickelter Angriff problemlos auf andere Versionen übertragen werden kann, was die Möglichkeit großflächiger Angriffe eröffnet.

Google hat bestätigt, sich der Bedrohung durch Fun-Tuning bewusst zu sein, hat sich aber noch nicht dazu geäußert, ob die Funktionsweise der Tuning-API geändert wird. Die Forscher weisen zudem auf das defensive Dilemma hin: Das Entfernen der von Fun-Tuning genutzten Informationen aus dem Tuning-Prozess würde die API für legitime Entwickler weniger nützlich machen. Umgekehrt würde ein unverändertes Verhalten weiterhin ein Sprungbrett für böswillige Akteure bieten, die die API ausnutzen wollen.

Das Aufkommen von Fun-Tuning ist ein deutliches Warnsignal: Die Konfrontation im Cyberspace hat eine neue, komplexere Phase erreicht. KI ist heute nicht nur ein Ziel, sondern auch ein Werkzeug und eine Waffe in den Händen böswilliger Akteure.

[Anzeige_2]

Quelle: https://thanhnien.vn/hacker-dung-ai-de-tan-cong-gemini-cua-google-18525033010473121.htm

![[Foto] Generalsekretär To Lam nimmt am 80. Jahrestag der vietnamesischen Diplomatie teil](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/25/3dc715efdbf74937b6fe8072bac5cb30)

![[E-Magazin] Petrovietnam – Starke Schritte zur Verwirklichung der „epochalen Transformation“](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/8/25/e745baade70f4e1e96f5314f65eac658)

Kommentar (0)