人工知能 (AI) を仕事に適用することは、効率の向上と時間の節約に役立つ避けられないトレンドになっています。

しかし、その利便性の裏には、データセキュリティに対する潜在的なリスク、特に「シャドーAI」という現象が潜んでいます。これは、従業員がAIツールを不注意に、制御なしに使用し、会社の機密データを誤って公開プラットフォーム上に公開してしまうことです。

依存と初期の懸念

化粧品・機能性食品会社でコンテンツマーケティングを担当するThanh Huyenさん(21歳)は、企画やコンテンツの構築から画像や動画のデザインまで、仕事の90%をAIに頼っていると語った。

しかし、ChatGPT に尋ねたアイデアに似た記事を偶然見つけた後、Huyen さんは AI が入力情報を記憶して共有する能力について心配し始めました。

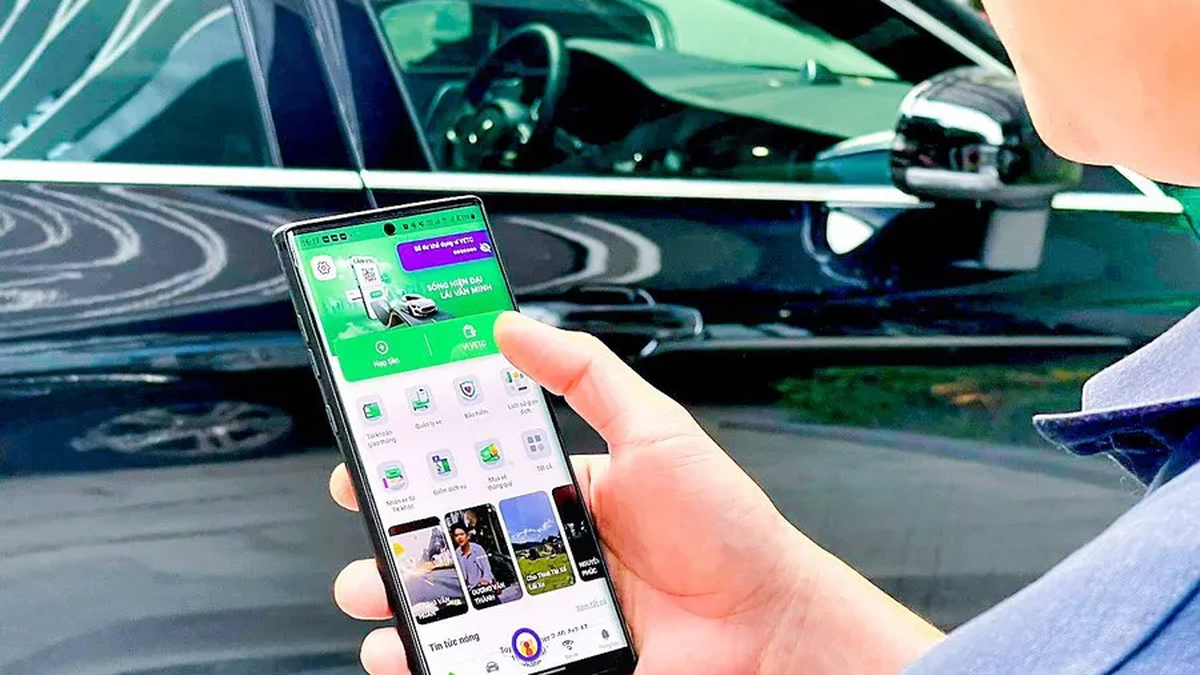

現在では、多くの業界では AI を仕事に応用することがほぼ標準となっている (写真: Bao Ngoc)。

Huyen 氏の話は偶然かもしれないが、AI に情報を提供するということは、これらのツールがデータを収集して保存し、モデルをトレーニングできるようにすることを意味する、というのは否定できない事実だ。

AI プラットフォームがハッキングされたり、セキュリティが不十分だったりすると、問題は深刻化し、情報漏洩や悪影響につながります。

「シャドーAI」 - 潜在的な危険性

カスタマーサービススペシャリストのHMさん(20歳)は、顧客情報のリスト(氏名、生年月日、電話番号、購入履歴)を定期的にAIに提供して分析することで、時間を節約し、パフォーマンスを向上させています。

M氏は、会社規模が小さく、データが公開されることもないため、潜在的なリスクはないと考えている。しかし、M氏のケースは「シャドーAI」の典型例であり、情報技術部門やサイバーセキュリティ部門の承認や監督なしに従業員がAIを利用することを指す。

「シャドーAI」とは、企業内で従業員が何らの管理や制御なくAIを利用する現象を指します(図:CV)。

シスコのレポートによると、ベトナムの組織の62%は、従業員によるAIの無許可使用を検知することに自信がないことが明らかになりました。また、英国の調査では、サイバーセキュリティ管理者の75%が、シャドーAIのような内部脅威を懸念していることも明らかになりました。

これは、多くの企業が AI の使用に関する明確なポリシーを持たず、従業員がデータ セキュリティに対する意識を欠いている場合、シャドー AI が一般的な脅威になりつつあることを示しています。

取り残されないようにトレードオフを受け入れる

リスクを認識しながらも、タン・フイエンはAIに「賭ける」ことを決意した。AIがもたらす即時的な恩恵はあまりにも大きく、毎日数十もの記事やアイデアを生み出すのに役立っていると彼女は考えている。

利便性、スピード、そしてパフォーマンス向上の能力により、Huyen 氏は上司の個人情報さえも AI に機密情報として提供することをいとわなくなりました。

AI を制御なしに使用すると潜在的なリスクがあるにもかかわらず、多くの従業員は依然として目先の利益のためにトレードオフを受け入れています (図: CV)。

同様に、コンテンツマーケティング従業員の Trung Hieu さん(20 歳)も、社内文書や業務情報を AI チャットボットに定期的に提供しています。

Hieu 氏は、生産性が大幅に向上し、競争上の優位性が生まれたことに気付きましたが、これが会社の運営にそれほど影響することはないと考えています。

これらの事例は、企業に明確なポリシーがないこと、従業員のセキュリティ、品質、依存性のリスクに関する認識が不十分なことが原因で、シャドー AI が蔓延していることを示しています。

AIを過信すると生じる一連のリスク

AIアプリケーションソフトウェア開発会社のCEO、グエン・ヴィエット・フン氏は、シャドーAIの人気は、AIによって仕事がより迅速かつ効率的になること、AIに依存する習慣がすぐに形成されること、そして企業にリスクに関する警告やトレーニングが不足していることの3つの要因によるものだと説明しています。

AIアプリケーションソフトウェア開発会社のCEO、グエン・ベト・フン氏(写真:コン・カイン)。

専門家は、シャドー AI が無料の AI ツールに組み込まれると、データ漏洩 (顧客、内部) につながる可能性があると警告しています。

さらに、AI によって生成されたコンテンツの品質は検証されていないため、偏りが生じやすく、ビジネス上の意思決定に影響を及ぼす可能性があります。

さらに深刻なことに、AI を無制限に使用するとセキュリティ上の脆弱性が生じ、IT システムによる監視や迅速な対応が困難になり、インシデント発生時の責任の所在特定が困難になる可能性があります。

暗い部分は制御が難しいです。

AIを活用した従業員の監視と管理は、長期にわたる調整を要します。専門家によると、従業員が社内データにアクセスできることは、個人のAIツールを通じて個人データを流用するのを防ぐ上で大きな障害となります。

さらに、AI ツールは簡単にアクセスできるようになったため、IT 部門による検出や管理が困難になっています。

AIツールへの容易なアクセスは、従業員がAIプラットフォームに提供する情報を制御することを困難にする障壁の1つです(図:CV)。

これに対処するため、専門家のグエン・ベト・フン氏は、企業はAI利用時のリスク認識に関する従業員研修を強化し、「シャドーAI」への理解を深める必要があると提言した。

同時に、法規制や社内ポリシーを迅速に制定してください。もう一つの重要な解決策は、行動監視、データアクセス制御、従業員一人ひとりへのきめ細かな権限付与など、企業全体のセキュリティ機能を強化することです。

現在、多くの企業ではAI活用に関する明確なプロセスが未だ確立されておらず、生産性向上のための活用のみを推奨しています。シャドーAI対策として、多くの大企業は社内AIプラットフォームの導入や、明確な情報セキュリティポリシーを備えた承認済みツールの使用を従業員に義務付け始めています。

出典: https://dantri.com.vn/cong-nghe/sep-buong-long-nhan-vien-than-nhien-cap-du-lieu-mat-cho-ai-20250806090132034.htm

![[写真] 党と国家の指導者がホーチミン主席の廟を訪れ、英雄と殉教者を追悼して線香を捧げる](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/8/17/ca4f4b61522f4945b3715b12ee1ac46c)

コメント (0)